Frieve(小林由幸) : Local AI の幻想を捨てろ!

(全体俯瞰 : AI 生成) click で拡大

前置き+コメント

小林由幸のこの主張は、正論 6割、極論 4割 ではなかろうか。

今後の、(ロボットを除いた)AI 利用の中心は研究者でも開発者でもまして個人ではなく、企業の一般事務業務で、当然社外秘が大半。

取引先企業のデータも関わってくるから自社の判断だけで、これを クラウド型 AI に任せるのは、現状では現実的ではない。

一方で、企業内部の様々な定型化、マニュアル化した人手による一般事務業務を AI 化によってコスト削減、効率化するという巨大な需要がある。

結局、

-

漏洩しても問題のないサンプル・データと処理方法を クラウド型 AI に与えて、local AI 専用の精密なプロンプト群を作成させ、

-

その専用プロンプト群を local AI に与え、local AI で社外秘の実データを処理させる

…といったような二段階の妥協案を採用することになるのではないか。

つまりクラウド型 AI に local AI の先生役をやらせるが、先生役にはサンプルデータだけ見せ、実データは見せない。local AI は先�生が詳細化、具体化した方法に基づいて実データを処理…といった二段階のそれぞれで AI を使い分ける事になるのではないか。

以下、情報源を NotebookLM で整理した内容。

要旨

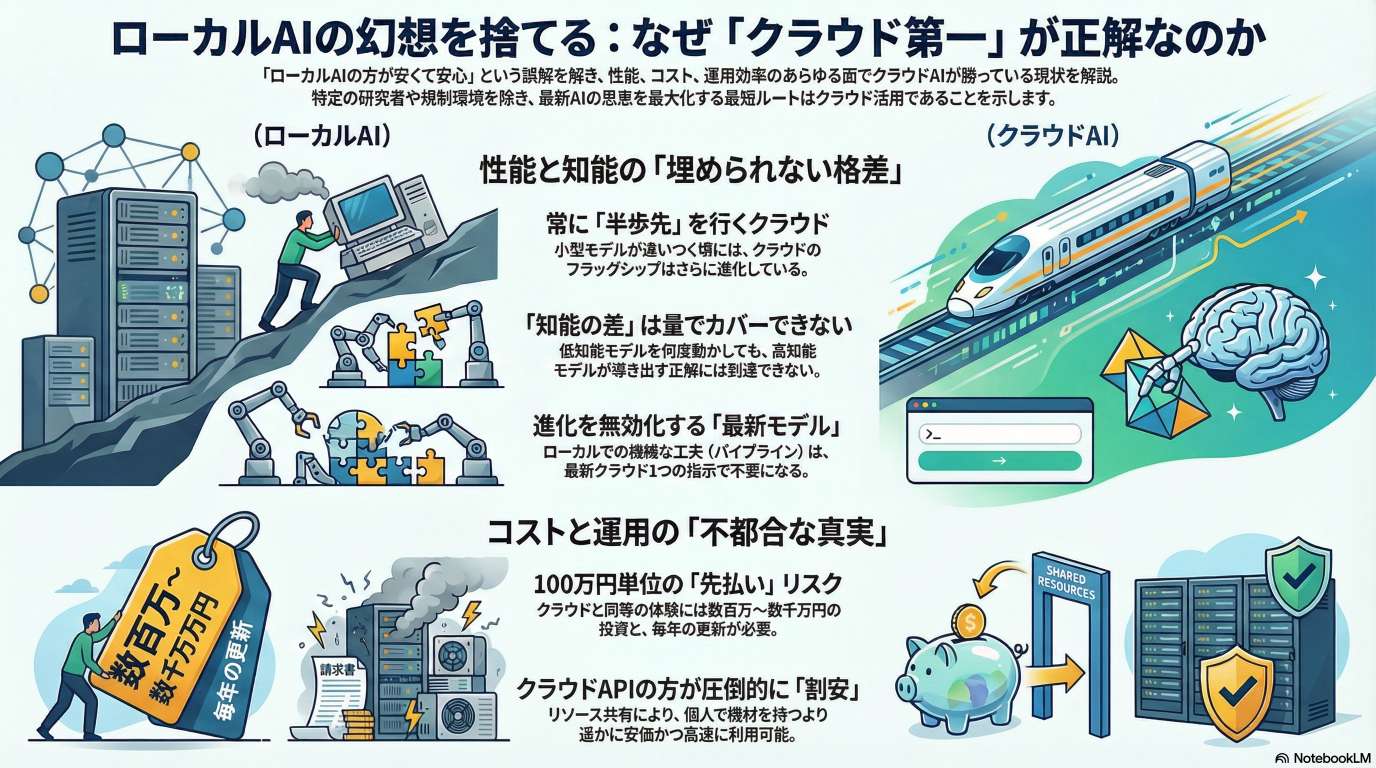

この動画は、多くのユーザーが抱く「ローカルAI(PC上での自前運用)」への憧れに対し、実用性とコストの両面から疑問を呈しています。

著者は、最新のクラウドAIサービスを利用することこそが、性能・費用・運用効率のすべてにおいて圧倒的に有利であると断言しています。ローカル環境で動く小型モデルが進化しても、巨大なリソースを背景とするクラウドのフラグシップモデルとの性能差は埋まらず、知能の差が成果に直結すると説いています。また、導入費用や電気代を考慮するとローカル運用は決して安価ではなく、セキュリティや管理の面でも専門家が運営するクラウドの方が強固です。

結論として、研究開発や特殊な規制がない限り、クラウドの先端技術を使いこなすことが最も合理的であると結論付けています。

目次

- 前置き+コメント

- 要旨

- ローカルAIの現状とクラウドAIの優位性に関する包括的分析報告書

- ローカルAIとクラウドAIの比較・分析表

- 性能の圧倒的格差

- コストと運用の落とし穴

- 効率性の違い

- セキュリティと技術力の誤解

- local AI が有効な例外事例

- 結論 : 取るべき戦略

- 情報源

ローカルAIの現状とクラウドAIの優位性に関する包括的分析報告書

エグゼクティブ・サマリー

本資料は、現代のAI活用における「ローカル環境(手元のPC等)」と「クラウド環境」の比較分析をまとめたものである。結論として、最新のAI技術を最大限に引き出し、実務的な成果を追求する立場においては、主戦場は完全にクラウドにある。ローカルAIが最適な選択肢となるのは極めて限定的な「コーナーケース」に過ぎない。性能、コスト、運用効率、セキュリティ、そして更新頻度のすべての面においてクラウドが圧倒的に有利であり、ローカルAIの導入は「より高いコストを払って、より低い性能のものを使う」という非合理な結果を招くリスクが高いことが示されている。

1. 性能と知能の格差:フラッグシップの絶対的優位

AIの本質は「知能」であり、知能の��差はそのまま成果の質に直結する。ローカル環境で動く小型モデルと、クラウド上のフラッグシップモデルの間には、埋めがたい性能差が存在し続けている。

スケーリング・ローとモデルサイズ

- 物理的制約: AIモデルは基本的にサイズが大きいほど高い性能を実現できる(スケーリング・ロー)。

- 性能の天井: ローカル環境(家庭用PCやMac)で動作させるためには、蒸留や量子化などの技術でモデルを軽量化する必要がある。しかし、その時点でクラウドの巨大なフラッグシップモデルには性能で及ばない。

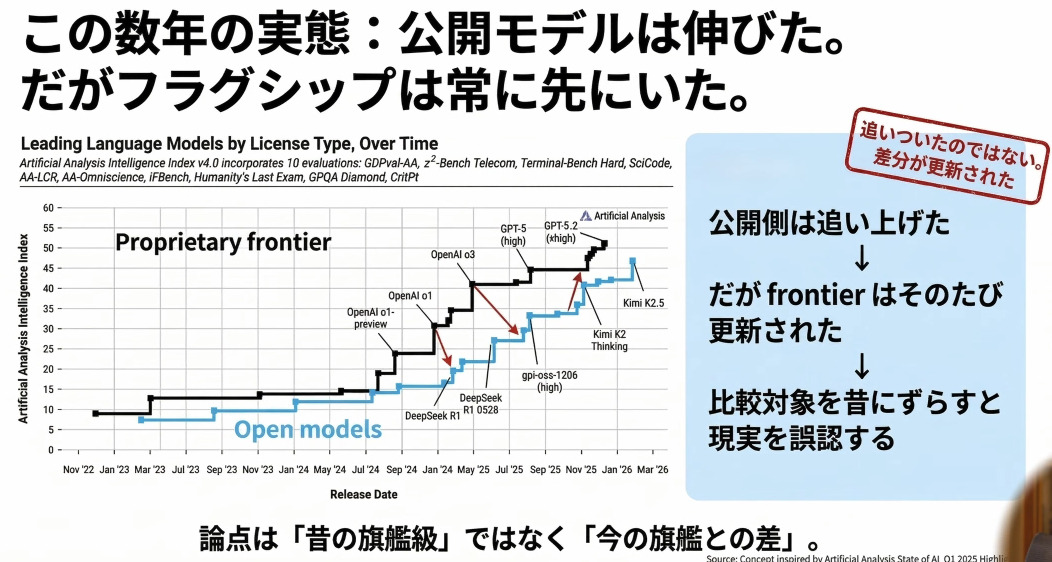

- 追っかけの構造: 「小型モデルがかつてのフラッグシップ並みの性能を達成した」というニュースは頻繁に流れるが、その時点で最新のクラウドモデルはさらにその先を行っている。2022年のChatGPT登場以来、ローカルモデルが最新のフラッグシップを上回った事例は一度もない。

知能の差がもたらす結果

- 代替不可能性: ソフトウェアの処理速度とは異なり、AIの知能は「低性能なモデルで時間をかけても、高性能なモデルが出す答えには永遠にたどり着けない」という性質を持つ。

- 高度な機能: ロングコンテキスト(長文理解)、動作の整合性維持、マルチモーダル性能(言語・画像・音声の統合)において、クラウドモデルは圧倒的であり、これらをローカルで再現しようとすると仕事の効率が著しく低下する。

2. コスト構造の再定義:ローカルAIは「安くない」

「月額課金を避けるためにローカルAIを導入する」という考え方は、経済的合理性に欠ける場合が多い。

導入と運用の隠れたコスト

- ハードウェア投資: 最先端のローカルAIを動かすには、数百GBのメモリや、数枚から数十枚の高性能GPUが必要となる。2枚、4枚の構成で数百万円、8枚構成なら2000万〜3000万円規模の投資が必要になる。

- 維持費と手間: サーバー級の電力消費、冷却設備、騒音対策、そして頻繁なアップグレードが必要となる。

- APIの価格破壊: クラウド各社は、ローカルで動くような軽量モデルのAPIを極めて安価(1日中呼び出し続けても少額)で提供している。多くの場合、自分でマシンを所有するよりも、これらの安価なAPIを利用する方が圧倒的に安く済む。

資源利用効率の比較

項目 クラウドAI ローカルAI GPU利用率 複数ユーザーで共有し、常にフル稼働に近い。 個人利用では大半の時間がアイドル状態。 電力効率 データセンターでの集中管理と最適化された冷却。 家庭用電力と非効率な冷却による高い環境負荷。 メンテナンス 運営側が自動で更新・最適化を行う。 ユーザー自身がモデルの設置や動作確認を行う。 3. セキュリティと信頼性の誤解

クラウドに対するセキュリティ懸念からローカルを選択する傾向があるが、これは客観的なリスク評価に基づかないことが多い。

- プロフェッショナリズムの差: クラウド事業者は世界最高峰のセキュリティ専門家を配し、天地がひっくり返るような事故を防ぐために最新の対策を施している。個人のPCやローカルサーバーがこれを超える堅牢性を持つことは困難である。

- 不合理な懸念: 他のクラウドサービス(AWSや一般的なSaaS)は信用しているにもかかわらず、AIに限って「データが送られるのが不安」と考えるのは、判断が雑であると言わざるを得ない。

- 真のセキュリティ対策: 重要なのは「環境がどこか」ではなく、認証、権限管理、暗号化、ログ監視といった「設計」の問題である。これらはローカルであってもクラウドであっても必要な知識であり、環境を変えるだけで解決するものではない。

4. ローカルAIが正当化される「例外的なケース」

極めて限定的な状況においては、ローカルAIの活用に合理性が認められる。

- 研究・開発者:

- モデルの内部挙動(ニューラルネットワーク内の信号等)を詳細に観察・分析する必要がある場合。

- APIのインターフ�ェースでは制限されているパラメータ調整やアーキテクチャの改造を行う場合。

- 物理的・契約的制約:

- 規制や契約により、どうしても外部クラウドとの通信が許可されない環境。

- インターネット接続が全く利用できない場所での運用。

- 極限の低遅延(低レイテンシ)要求:

- クラウドとの往復通信時間(ミリ秒単位)がボトルネックとなり、反射神経的な応答が求められる特殊な用途。

- 大規模オンプレミス:

- 数千台規模のサーバーを運用し、自社で専門チームを抱えることで、クラウド利用料よりも運用コストが下がる大規模組織。

5. 結論:目的に対するストイックな選択

AIを使いこなすための本質的な技術力とは、「ローカルで動かせること」ではなく、「最新・最高性能のモデルをいかに組み合わせて目的を達成するか」にある。

- 手段の目的化を避ける: ローカル環境構築に多額の資金と時間を投じると、サンクコスト(埋没費用)により「低性能なローカルAIを使わざるを得ない」状況に陥る。

- 進化の速度への対応: 複雑なローカルAIのパイプラインを数ヶ月かけて組んでも、次の瞬間にリリースされたクラウドのフラッグシップモデルが、自然言語の指示一つでそれ以上の結果を出してしまうのが今のAI界の現実である。

成果を最大化したいのであれば、常に世界最高峰のクラウドAIを中心に据え、必要に応じて複数のモデルを最適に使い分ける(オーケストレーションする)アプローチが最も合理的である。

ローカルAIとクラウドAIの比較・分析表

比較項目 クラウドAIの特徴 ローカルAIの特徴 推奨されるケース コスト・運用効率 性能・アップデート セキュリティ・信頼性 基本性能・知能 巨大なモデルサイズにより圧倒的な知能、長いコンテキスト、マルチモーダル性能を持つ。常に最新のフラッグシップモデルが利用可能。 小型モデルが中心。1年前のフラッグシップ並みの性能に到達することもあるが、現時点の最高峰には決して及ばない。 成果を最大化したい、高度な知的作業を効率化したい、最新機能を即座に利用したい場合。 サブスクリプションやAPI従量課金。必要な時に必要な分だけリソース(GPU)を共有するため、利用効率が極めて高い。 各社からリリースされる最新モデルに即座にアクセス可能。運営側が自動で最適化・更新を行う。 世界最高峰のプロによる強固な対策。機密保持契約(API)に基づき、データ学習への利用を制限可能。 コス��ト・ハードウェア 初期費用なし。低性能モデルのAPIは非常に安価で、ローカルで稼働させるよりも経済的なケースが多い。 高性能モデルの動作には数百万円から数千万円(GPU8枚等)の導入コストが必要。電気代や冷却、騒音の問題も発生。 データセンター並みの設備を持つ企業や、特殊な規制でクラウドが一切使えない極めて限定的なケース。 ハードウェアの先払いが必要。GPUの利用率が低くなりがちで、メンテナンスや電気代を含めると割高になる。 自力でインストール、動作確認、ハードウェアの増設・更新を行う必要があり、多大な手間と時間がかかる。 物理的に手元にある安心感はあるが、個人の管理レベルではクラウドの専門的なセキュリティに劣る場合が多い。 利用用途・合理性 汎用的かつ実務的。複数のモデルをオーケストレーションし、最短・最安で目的を達成できる。 研究開発、モデルの内部挙動(ニューラルネットの信号)の観察、通信遅延が許されないリアルタイム制御に限定。 AI研究者、開発者、特殊なオフライン環境、ミリ秒単位のレスポンスが求められる特殊なエッジAI。 手段が目的化しやすく、投資額(サンクコスト)に縛られて低性能なモデルを使い続けるリスクがある。 ローカルでの工夫は、数ヶ月後のクラウド最新モデルの指示一つで無用(技術的負債)になることが多い。 「クラウドは不安」という心理的要因で選ばれがちだが、多くの場合において技術的な合理性は乏しい。 [1] 【AI】ローカルAI…?忘れろ。

以下、mind map から

性能の圧倒的格差

提供されたソースは、ローカルAIとクラウドAIの間には単なる処理速度の違いを超えた決定的な「知能」の差が存在し、最新のAIを活用して成果を出すためにはクラウドAIを利用することが圧倒的に優位であると指摘しています。

これらのソースが語る「性能の圧倒的格差」の実態と、その背後にある大きな文脈は以下の通りです。

1. 永遠に埋まらない最新モデル(フラッグシップ)との差

ローカルで動く小型モデルが高性能化したというニュースが頻繁に流れますが、それはあくまで「半年以上昔のクラウドのフラッグシップモデル」に追いついたという比較に過ぎません。ローカルモデルが過去の性能に追いついた頃には、最新のクラウドモデルはさらに遥か先へと進化しています。ソースは、ローカルモデルがその時点でのクラウドの最高峰モデルの性能を超えたことは過去一度もなく、今後も未来永劫ないと断言しています。

2. スケーリング則とハードウェアの物理的限界

AIモデルは「サイズが大きければ大きいほどより高い性能を実現できる(スケーリング則)」という根本的な性質を持っています。クラウド環境には何千台ものGPUが用意されており、極めて巨大で高性能なモデルを複数GPUで効率的に動かすことができます。一方、これをローカルで実現しようとすれば、高価なGPUを何枚も搭載した数百万円か�ら数千万円クラスのマシンと、膨大な消費電力や冷却設備が必要になり、現実的ではありません。

3. 「時間の問題」では解決できない決定的な知能差

通常のパソコンソフトであれば、マシンスペックが低くても「時間をかければ」同じ結果を得ることができますが、AIの場合は異なります。AIの性能差は「知能の差」であり、知能が低いローカルモデルをいくら長時間稼働させても、知能が高いクラウドモデルが出せる高度な答えには永遠にたどり着けません。最新のクラウドAIは、長大な文脈(ロングコンテキスト)を維持して一貫性のある高度な思考を行ったり、言語や画像を組み合わせたマルチモーダル処理をいとも簡単にやってのけますが、ローカルAIではそれが破綻するか、非常に複雑で非効率なパイプラインを組む必要があります。

4. ローカルAIの現実:コストと手間の罠

クラウドAIの課金を避けるためにローカルAIに投資するのは、多くの場合「高くついて低性能」という結果を招きます。

- 初期導入費用だけでなく、毎年のハードウェアのアップデート、電気代、動作確認などの多大な運用コストがかかります。

- クラウド各社は、最高性能のモデルだけでなく、ローカルで動かせるレベルの小型AIのAPIも「激安」で提供しています。そのため、あえて低性能なAIを利用したい場合であっても、クラウドAPIを利用した方がコストを抑えられます。

結論:例外的なケースを除き、主戦場はクラウド

ソースによれば、ローカルAIが真に必要とされるのは、通信ラグすら許されな�い超低遅延の要件や、クラウドへの接続が法規制などで禁じられている環境、あるいはAIモデルの内部アーキテクチャに直接手を入れる必要がある研究開発など、ごく一部の例外(コーナーケース)に限られます。

それ以外の圧倒的多数の一般ユーザーや開発者にとって、ローカルAIに固執することは「手元で動かすという手段が目的化」しており、結果として高額な費用を払って劣ったモデルを使い続けることになります。真に成果を最大化したいのであれば、機能もセキュリティも資源効率も圧倒的に優れるクラウドの最先端AIにアクセスし、それを徹底的に使いこなすことが最も合理的な選択です。

コストと運用の落とし穴

クラウドのサブスクリプション代を節約するためにローカルAIを導入することは、結果的に「より高いコストを払って、より低性能なAIを使い続ける」という致命的な罠に陥るとソースは警告しています。ローカルAIにおけるコストと運用の落とし穴の実態は、以下の要素から成り立っています。

1. 「初期投資で済む」という幻想と隠れた莫大なコスト

ローカルAIは決して無料ではなく、実際にはクラウドのサブスクリプションに払うはずだったお金をハードウェア代として「先払い」しているに過ぎません。最先端モデルに少しでも近づけようとすれば、高価なGPUを複��数枚(数百万円から数千万円規模)搭載する必要があります。さらに、それを24時間稼働させるための跳ね上がる電気代、サーバー部屋のような冷却設備、凄まじいファン騒音といった隠れた運用コストが重くのしかかります。

2. 終わりのないハードウェア更新とメンテナンスの負担

クラウドであれば、API経由で常に最新かつ最高性能のモデルが自動的に利用可能になりますが、ローカル環境では自分自身で管理しなければなりません。毎年のようにハードウェアをアップグレードし、新しいモデルが出るたびに自分でインストールして動作確認を行うという、多大なメンテナンスの手間が発生します。結果として、AIを活用して成果を出すことよりも、ローカル環境を維持・構築すること自体が目的化してしまう(手段の目的化)危険性があり、サンクコスト(埋没費用)に縛られて劣ったAIを使い続ける状況に陥りがちです。

3. 絶望的なリソース利用効率の悪さ

個人で高スペックなマシンを用意しても、常にAIを限界まで使い続けるわけではないため、GPUの利用効率はせいぜい数%〜10%程度と「むちゃくちゃ遊んでいる」状態になります。一方、クラウドは世界中のユーザーのリクエストを束ねて処理するため、GPUをほぼフル稼働させることができ、圧倒的に高いハードウェア利用効率と電力効率を実現しています。個人が自宅の非効率な電力と冷却でローカルAIを稼働させることは、経済的にも環境負荷の面でも極めて非合理です。

4. クラウドの「激安API」という現実の見落とし

「自分には高性能なモデルは不要で、低性能な小型モデルが無尽蔵に使えればいいからローカルを選ぶ」という考えも落とし穴です。クラウド各社は、手元で動くような小型AIのAPIを「バカみたいに安い(激安)」価格で提供しているため、高額なローカルマシンを買うよりも、低コストなクラウドAPIを呼び出しまくる方が結局は安く済みます。ローカルAIを選ぶことは、コストを下げられないばかりか、いざ最高性能のモデルが必要になった際の選択肢を自ら狭める行為に他なりません。

5. セキュリティに対する誤った認識

「クラウドはデータが外部に送られるから不安で、ローカルなら手元でコントロールできるから安全」というのは、多くの場合誤った思い込みです。クラウド各社はAPI経由のデータを学習に使わないと明言しており、世界トップクラスのプロフェッショナルによる最高峰のセキュリティ対策を施しています。それに比べて個人が家庭で運用するローカルサーバーのセキュリティは「ざるもいいところ」であり、本質的な安全性はローカルかクラウドかではなく、適切な権限管理や暗号化といった設計・運用の問題に過ぎません。

総じて、ローカルAIが真にコスト面や運用面で見合うのは、数千台規模のサーバーを自社運用して専任の保守担当者を置けるような大企業や、ミリ秒単位の通信ラグすら許されない特殊な環境などに限られます。それ以外の圧倒的多数のユーザーにとっては、目的に応じてクラウドの最先端APIや激安APIを柔軟に使い分けることが、コスト・運用・性能のすべての面で最も合理的な選択肢と�なります。

効率性の違い

提供されたソースは、ローカルAIとクラウドAIの間には、単なるマシンスペックの差を超えた「リソースの利用」「電力と環境」「運用保守」「実務作業」というあらゆる次元において、比較にならないほどの圧倒的な効率性の違いが存在すると指摘しています。

その具体的な内容は以下の通りです。

1. ハードウェア利用効率(稼働率)の劇的な差

クラウド環境では、世界中の複数ユーザーからの膨大なリクエストを束ねて処理するため、GPUの使用率を極めて高く保つことができ、ほとんどの時間においてほぼフル稼働しています。一方、個人のローカル環境でAIを動かす場合、24時間絶え間なくリクエストを送り続けるような極端な使い方をしない限り、GPUの利用率は1%〜10%程度と「むちゃくちゃ遊んでいる(待機している)」状態になります。同じGPUを1枚用意したとしても、クラウドとローカルではそのハードウェアから引き出せる価値(利用効率)が全く異なります。

2. 電力効率・冷却効率と環境負荷

利用率が極めて高いAIデータセンターは、冷却効率の良い寒冷地に建設したり、専用の発電所を設けたりすることで、電力供給と冷却を集中的かつ極めて効率的に行っています。もし、このクラウドが処理している膨大なAIタスクを世界中のローカルPCに分散させたとすると、各家庭の非効率な排熱(暖房効率すら悪いヒートポンプではない暖房器具のような状態)によって何倍もの電力が浪費されます。さらに、利用効率の低い個人のために大量のGPUやメモリを生産しなければならず、環境負荷も跳ね上がります。資源の利用効率や環境への配慮という観点からも、クラウドに集約することが合理的です。

3. 運用・メンテナンスの効率

クラウドであれば、APIの向こう側で専門家がシステムのアップデートやメンテナンスを集中的に行っており、何もしなくても自動的に性能が上がっていきます。しかしローカル環境では、新しいモデルが出るたびに自分自身でインストールし、動作確認を行い、ハードウェアの構成も定期的に見直す必要があります。この運用のオーバーヘッドは、AIを活用して成果を出すという本来の目的から見れば極めて非効率です。

4. 実務(タスク実行)の効率

仕事の成果に直結する処理効率の面でも、クラウドAIが圧倒的に優位です。最新のクラウドAIは、長大な文脈(ロングコンテキスト)を維持したまま破綻せずに思考したり、言語や画像を組み合わせたマルチモーダル処理を単体でスムーズにこなします。昔のAIや現在のローカルAIで同等のことを実現しようとすれば、細かいモデルをいくつも組み合わせた複雑なパイプライン(仕組み)を一生懸命構築しなければならず、実務上の仕事の効率が全く変わってしまいます。

結論

ソースは、ローカルAIを選択することは、一見すると自分の手元で処理を完結させているように見えて��、実際には電力効率、ハードウェア利用効率、処理効率、メンテナンスのすべての面において「どんどん非効率になる」行為であると結論づけています。例外的な用途(通信ラグが許されない、完全なオフライン環境など)を除き、クラウドの集約効果によって研ぎ澄まされた高効率なリソースを利用することが、最も合理的で成果につながるアプローチです。

セキュリティと技術力の誤解

提供されたソースは、「ローカルAIとクラウドAIの優位性」という大きな文脈において、ローカルAIに対する「セキュリティの安全性」と「それを扱う技術力の高さ」という2つの一般的なイメージが、どちらも事実とは異なる大きな誤解であると指摘しています。

具体的な説明は以下の通りです。

1. セキュリティに対する誤解:「ローカルは安全、クラウドは危険」という幻想

ソースは、「データが外部に送られるからクラウドは不安で、手元で動かすローカルなら安全」という考えを、インターネット黎明期やAWS登場時にも繰り返された感情的で非合理的な恐れであると指摘しています。

- API利用におけるデータ保護: クラウド各社は、API経由で入力されたデータをAIの学習には使用しないと明言しており、秘密は守られます。これは企業が既に利用している他のクラウドサービスと契約上もセキュリティ上も何ら変わりません。

- プロの対策 vs 個人の「ざる」な環境: クラウドサービスは世界中の企業が利用しており、万一事故が起きれば大ニュースになるため、世界最高峰のプロフェッショナルによる最高レベルのセキュリティ対策が施されています。それに比べれば、各家庭や個人が運用するローカルサーバーのセキュリティは「ざるもいいところ(穴だらけ)」であり、単に狙う価値がないからハッキングされていないだけだと述べています。

- 本質は「場所」ではなく「設計」: セキュリティの安全性は、ローカルかクラウドかという環境の違いで決まるものではありません。適切な認証、権限管理、暗号化、監査といった全体の運用設計こそが重要であり、AIになった途端にクラウドだけを極端に恐れるのは「判断が雑なだけ」であると切り捨てています。

2. 技術力に対する誤解:「ローカルAIを動かせる=技術力が高い」という錯覚

ローカルでAIを動かしている人を見ると「なにかすごい技術を持っているのではないか」と思われがちですが、これも誤解です。

- お金とハードウェアがあれば誰でもできる: 現在はソフトウェアの基盤が整っており、オープンソースのモデルやDockerのような仮想環境が簡単に利用できます。そのため、高価なハードウェアさえ用意すれば、あとはAIに設定手順を聞くだけで誰でも簡単にローカルAIを動かすことができ、特別な技術力は全く必要ありません。

- 真の技術力は「クラウドAPIのオーケストレーション」にある: ソースは、本質的な技術力とは「ローカルマシンを構築・維持すること」ではなく、「最先端・最高性能のクラウドAIを中心に、複数のAPIをいかに連携(オーケストレーション)させて使いこなすか」であると断言しています。

- プロフェッショナルの合理的な選択: 本当に優秀な研究開発者やAIを実務で活用しているプロは、ローカルかクラウドかという「手段」にはこだわりません。速度、性能、コスト、そして目的を最速で達成できるかをストイックに追求した結果、最も合理的な選択肢として「自動的にクラウドAPIばかりを使うことになる」のです。

結論として、セキュリティの不安からローカルに逃げ込んだり、技術力を誇示するため(あるいは手段が目的化して)ローカルAIにこだわることは、「より高いお金を払って、より低性能なAIを使い続ける」という非合理的な結果を招くと結論づけられています。真に成果を出したいのであれば、これらの誤解を捨て、圧倒的に優位なクラウドAIを徹底的に使いこなすことに注力すべきです。

local AI が有効な例外事例

ソースは、圧倒的多数の一般ユーザーや開発者にとってクラウドAIが主戦場であると断言した上で、ローカルAIが有効(あるいは�必須)となるのは「ものすごいコーナーケース(極めて稀な例外)」に限定されると説明しています。

そのより大きな文脈において、ローカルAIが真に合理性を持つ具体的な例外ケースは以下の4点に集約されます。

1. 物理的・インフラ的な制約(超低遅延・通信不可環境)

クラウドとの通信にかかる時間(ラグ)や、通信のための電力消費すら許容できないケースです。具体的には、オンプレミスのサーバーに情報が飛んできて、反射神経のように数ミリ秒単位(行って帰って2ミリ秒など)での応答が求められるシステムがこれに該当します。また、通信インフラが一切使えない完全なオフライン環境や、一瞬でも通信が途切れたら使い物にならなくなる(致命的な事故につながる)ようなシビアな状況下で稼働するAIも、ローカルAIならではの領域です。

2. AIの研究開発(モデル内部アーキテクチャへのアクセス)

AIモデルそのものを開発・研究している専門家や、クラウドAPIを提供する側の用途です。クラウドAPIは入出力のインターフェースしか提供しないため、ニューラルネットワーク内部でどのような信号が流れ、どこでどういう挙動を示しているのかを詳細に観察・分析したり、アーキテクチャそのものに手を入れて改造したりすることができません。未発表のAIモデルを極めて自由度高く、内部まで踏み込んで実験・開発する必要がある現場では、ローカル環境が必須となります。

3. 規制や契約上の絶対的な縛り(コンプライアンス)

法規制��やクライアントとの厳格な契約上の理由で、データを絶対にクラウド(外部環境)へ送信することが禁じられているケースです。この場合、どんなにコストが高くつき、性能が劣っていたとしても、AIを全く使わないよりはマシという「ルール上、オンプレミス(ローカル)でやるしかない」という消極的な理由でローカルAIが選択されます。

4. 専任担当者を置ける超大規模なオンプレミス運用(条件付き)

個人のPCレベルではなく、企業内で数十台から数千台以上のサーバー規模で運用するオンプレミス環境です。この規模になれば運用コストが平準化され、専任の保守担当者を置くことでオーバーヘッドを吸収できるため、クラウド各社にAPI利用料を払い続けるよりも安く済む可能性があります。ただし、この場合であっても「一生懸命開発・運用したモデルが、数ヶ月後に出たクラウドの最新フラッグシップモデルによって無用の長物と化す」というリスクは避けられません。

結論

ソースは、これらの特殊な例外ケースに当てはまる用途は全体の中で「本当に何パーセントあるんだろう」というレベルのごく一部に過ぎないと述べています。一般のAI利用者や実務において成果を出したい人が、こうした例外と自身の状況を混同し、「手段が目的化」してローカルAIに手を出せば、はるかに高いお金を払ってはるかに低性能なAIを使い続ける罠に陥ります。最高性能を最短・最安で引き出すためには、本当にローカルが必要な「1部分」だけを例外として切り出し、基本的にはクラウドAIを徹底的に連携させて��使いこなすことが真に合理的なプロの選択です。

結論 : 取るべき戦略

圧倒的多数のAIユーザーや開発者が取るべき真の戦略は、ローカルAIという言葉や表面的なニュースに惑わされず、常に世界最高峰のクラウドAIにアクセスし、それらを徹底的に使いこなすことに全力を注ぐことです。

ソースが提示する、今後のAI活用において成果を最大化するための具体的な戦略は以下の通りです。

1. 手段の目的化を避け、成果(目的)に対してストイックになる

AIを活用する最大の理由は「高い成果(アウトプット)を出すこと」です。セキュリティへの非合理な不安や「手元で動かしたい」という所有欲からローカルマシンに大金を投じると、そのサンクコスト(埋没費用)に縛られ、結果的に「低性能なモデルを高いコストで使い続ける」という本末転倒な事態に陥ります。速度、性能、コスト、そして「今すぐそれが実行できるか」という基準でストイックに最適解を求めれば、おのずと自動的にクラウドAPIばかりを選択することになります。

2. 本質的な技術力「オーケストレーション」を磨く

現代において、AIを手元で動かすこと自体には何の技術力も必要ありません。本当に優秀な開発者やAI活用者が実践している真の技術力とは、毎月のよう各社からリリースされる最先端AIモデルの機能と性能�を正確に見極め、自身の目的達成のために「どのモデルとどの機能をどう組み合わせて最適に使い分けるか(オーケストレーション)」を設計・実行する能力です。複雑なパイプラインをローカルで自作する時間があるなら、自然言語の指示一つで高度な処理をこなせる最新のクラウドモデルをいち早く業務に組み込むべきです。

3. ローカルAIは「極小の例外」として局所的に切り出す

システムや業務の全体をローカル環境で構築しようとするのではなく、基本戦略はクラウドを大前提とします。その上で、超低遅延が必須な処理や、法規制などでどうしても外部に出せないデータなど、「ここだけはどうしてもローカル環境が必要である」という1部分だけを明確に切り出し、そこに対してのみ例外的にローカルAIを適用するのが、最も合理的でプロフェッショナルなアプローチです。

結論

「ローカルAIの進化」といった言葉に踊らされて不必要なマシンの構築に時間とコストを浪費するべきではありません。世界で最も賢く、安く、効率的な最先端のクラウドAIツール群を常に監視し、最速で自分の仕事に適用し続けることこそが、AIの知能格差がそのまま成果の差に直結する現代において、私たちが取るべき唯一にして最強の戦略です。

情報源

動画(25:49)

https://www.youtube.com/watch?v=azU80D0spV0

200 views 2026/03/30

(2026-03-30)