Qwen 3.6-35B-A3B : API 課金破産を回避する local LLM の実現の可能性

(全体俯瞰 : AI 生成) click で拡大

前置き+コメント

先月の過去記事で

Frieve(小林由幸) : Local AI の幻想を捨てろ! (2026-03-30)

という意見を取り上げたが、Local AI 否定派の常識は必ずしも成立しない。たとえば、

- 社外秘のデータを扱う用途

- 膨大なデータを一貫性を持たせてあらゆる方向から徹底的に長時間かけて分析させる用途

- AI 企業の設けた制限なしに AI を使う用途

などでは、急激に進化しつつある local AI でないと対応できない。

こういった事例、とくに 2. では処理すべきデータ量、処理時間、コンテキスト長が膨れ上がるが、それをクラウド AI のAPI 課金で処理すると破産しかねない。

最近公開された Qwen 3.6 などはその叩き台として使えそうな気がする。ただし、一般的な普及価格帯の GPU ならば RAM 128GB 以上が前提だとあるので、この際、Windows ベースではなく、Mac Studio Ultra あたりを��導入した方が良いかも。

【重要】システムRAMへのオフロードに関する警告: RTX 4070(12GB VRAM)等のミドルレンジ環境での動作事例(7.19 sec/token)がありますが、これは不足分をシステムメモリ(RAM)で補った場合の数値です。この運用には128GB以上の大容量システムRAMが前提となります。RAM容量が不足(16GB〜32GB等)している場合、オフロード機能は動作せず、システムクラッシュを招くリスクが極めて高くなります。

以下、情報源を NotebookLM で整理した内容。

要旨

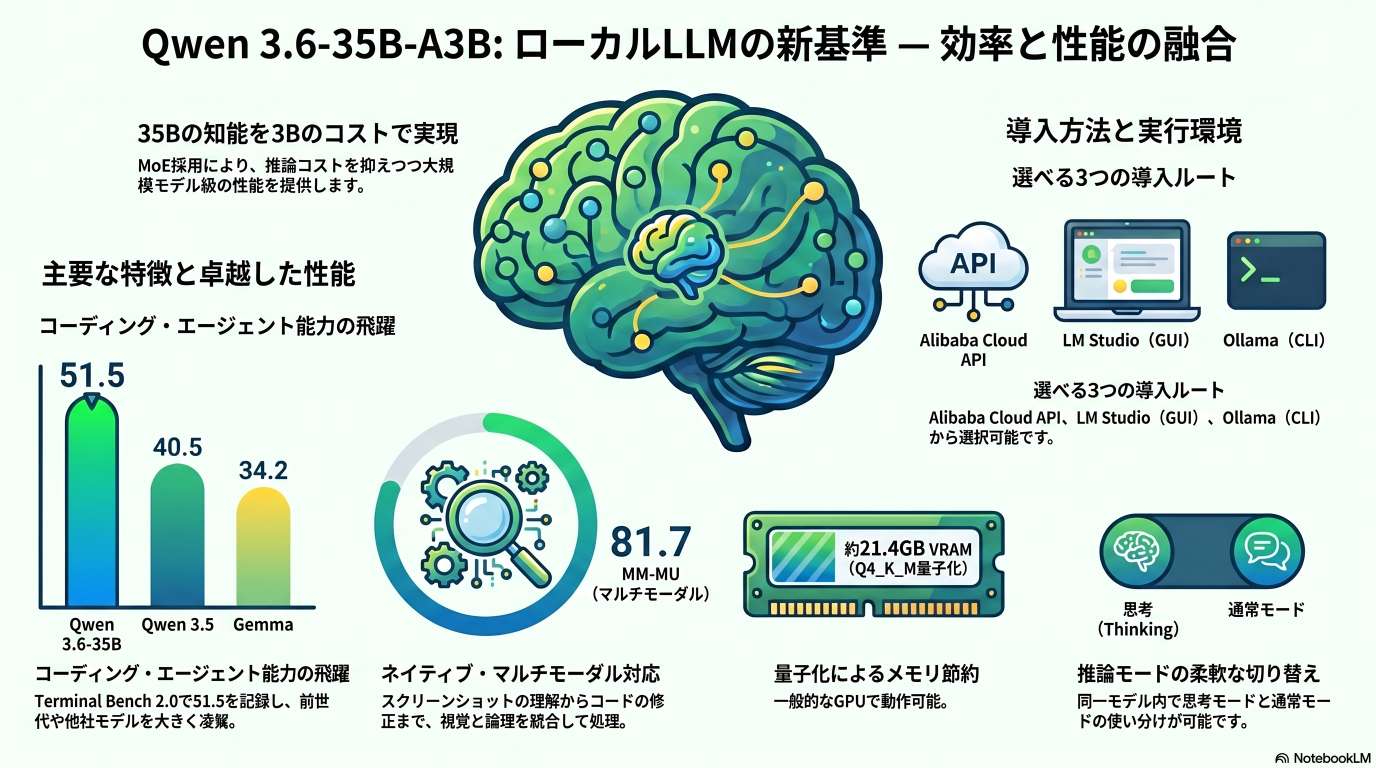

このテキストは、Alibaba Cloudが公開した最新のマルチモーダルAIモデル「Qwen 3.6-35B-A3B」の性能と導入方法を詳しく解説しています。

このモデルは、350億パラメータという規模を持ちながら、推論時には30億パラメータのみを活性化させる効率的なアーキテクチャを採用しているのが特徴です。特にコーディング能力やエージェント機能において優れたスコアを記録しており、画像認識を含むマルチモーダルなタスクにも標準で対応しています。

利用者は、AlibabaのAPI経由だけでなく、LM StudioやOllamaを通じて個人のMacBookやRTX 4070搭載PCでローカル実行することが可能です。高いコストパフォーマンスとApache 2.0ライセンスによる柔軟性を備えていますが、実務での導入には推論の冗長性や特定条件下での速度低下といった課題も考慮する必要があります。

総じて、エンジニアリングや視覚的推論を効率化したいユーザーにとって、強力な選択肢となるモデルであると結論付けています。